Прогноз дезинформационных сценариев на 2026 год сделали в казахстанском Центре по борьбе с дезинформацией

В 2026 году дезинформация окончательно закрепится как системный и фоновый элемент информационного пространства. Речь идет не о единичных фейках или резонансных вбросах, а о постоянно действующем механизме воздействия, который влияет на восприятие, эмоции и поведение людей. Информационные искажения все чаще будут встраиваться в повседневный контент и восприниматься как естественная часть медиасреды, передает Astana TV со ссылкой на Центр.

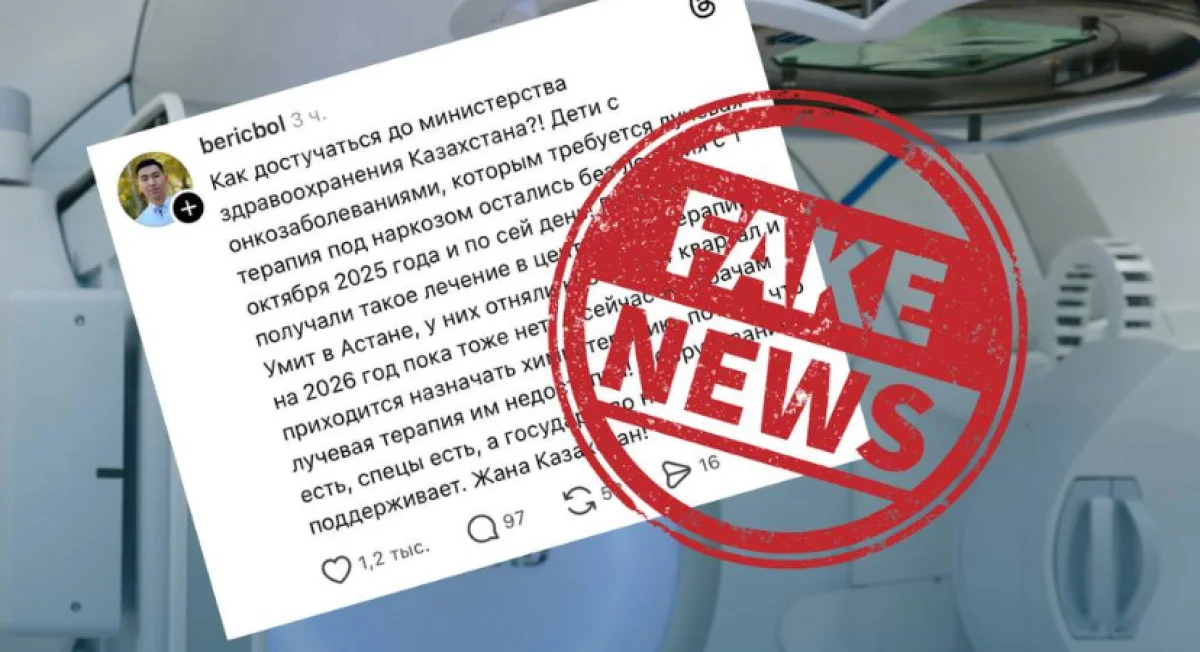

Одним из ключевых сдвигов станет переход от борьбы за внимание к управлению поведением через эмоции. Если ранее дезинформация конкурировала за клики и охваты, то в 2026 году в центре окажется т.н. «поведенческий маркетинг»: сначала контент захватывает внимание, затем целенаправленно вызывает эмоциональную реакцию — тревогу, возмущение, страх или чувство несправедливости — и после этого подталкивает к конкретным действиям. Манипуляция все реже будет выглядеть как прямой призыв, все чаще — как «естественное» эмоциональное решение самого пользователя.

Информационное поле будет насыщаться сообщениями, формирующими ощущение постоянной нестабильности и скрытых угроз. Даже нейтральные события будут подаваться как симптомы системного сбоя, а позитивные изменения — как временные и обманчивые. В такой среде эмоциональное напряжение становится фоном, на котором дезинформация распространяется быстрее и воспринимается как правдоподобная.

Отдельным фактором риска станет усиление гео-ориентированного продвижения ответов нейросетей и рекомендательных алгоритмов. В 2026 году одна и та же тема или событие может интерпретироваться по-разному в зависимости от страны, региона или даже города. Пользователь, обращаясь к поиску или ИИ-сервису, будет получать ответы, адаптированные под локальный контекст, медиаполе и доминирующие нарративы. Это создает эффект «доказательности»: разные версии одной реальности подтверждаются разными источниками, но лишь внутри своей географии. В результате манипуляция перестает выглядеть как ложь и начинает восприниматься как «локальная правда».

В редакциях СМИ и другими создателями контента все активнее будут использоваться генеративные агенты для написания текстов, подготовки заголовков, анализа данных и визуализации. Это увеличит количество непреднамеренных ошибок, неточностей и упрощенных интерпретаций. Даже без злого умысла такие материалы могут искажать факты, усиливать эмоциональные рамки и воспроизводить скрытые нарративы, заложенные в обучающих данных.

Размывание границы между управляемыми кампаниями и стихийными процессами продолжится. Целенаправленные воздействия будут запускаться так, чтобы дальше они распространялись органически — через комментарии, репосты и реакции обычных пользователей. Поляризация при этом станет не побочным эффектом, а самостоятельной целью. Разделенная аудитория легче поддается эмоциональному управлению и реже способна к рациональному диалогу.

В этих условиях в 2026 году дезинформация все чаще будет действовать не через откровенные фейки, а через работу с эмоциями, алгоритмами и поведенческими моделями, незаметно влияя на восприятие и решения людей. Поэтому особое значение приобретает понимание принципов работы генеративных моделей и нейросетей, их ограничений и рисков искажения контекста, а также привычка опираться на верифицированные источники информации.